Top config PC MAO 2021 (test, bench, discussion, débat...)

- 1 405 réponses

- 55 participants

- 99 617 vues

- 74 followers

Darkmoon

Je créer ce nouveau thread pour faire suite à ces deux derniers (créés par moi-même et Charles Bunk) :

Top config PC MAO 2019 (test, bench, discussion, débat...)

Top Config M.A.O 2020

Nous poursuivons donc ici à causer des nouveaux processeurs du moment. Nous effectuons parfois des tests et des benchs. Nous causons aussi de configuration MAO et d'optimisation, de notre façon de bosser dans tel ou tel DAW, etc. Nous partageons nos machines et configs et aiguillons les newbs et/ou ceux qui posent des questions vers la machine la plus appropriée pour leur besoin et, bien sûr, nous débattons parfois, mais dans la bonne humeur et le respect, parce que nous sommes passionnés, mais ne partageons pas tous forcément les mêmes idées et opinions (ce qui est très bien ainsi!). Bref, le sujet est relativement libre et ouvert, du moment que ça concerne l'informatique et la MAO!

Voilà, en souhaitant de bons échanges à tous pour cette nouvelle année 2021!

"Si t'enregistres à Poudlard, avec l'ingé son Dumbledore, les lois physiques tu peux t'en foutre. Mais dans l'monde réel, les lois physiques, les mesures, le dBFS, tout ça existe bel et bien." youtou

madamereve

Ca ne baisse pas la latence justement de bosser à une fréquence plus élevée ?

Si mais ça demande plus de ressources processeur. Perso, je bosse à 4800 pour gagner un peu de gain en latence mais au-dessus, c'est pas utile. Voire pire selon des tests.

https://web.archive.org/web/20200202124704/https://people.xiph.org/~xiphmont/demo/neil-young.html

Un extrait traduit :

Les fichiers musicaux numériques à 192 kHz n'offrent aucun avantage. Ils ne sont pas tout à fait neutres non plus ; la fidélité pratique est légèrement plus mauvaise. Les ultrasons sont un handicap lors de la lecture.

Ni les transducteurs audio ni les amplificateurs de puissance ne sont exempts de distorsion, et la distorsion a tendance à augmenter rapidement aux fréquences les plus basses et les plus hautes. Si le même transducteur reproduit les ultrasons en même temps que le contenu audible, toute non-linéarité déplacera une partie du contenu ultrasonore vers le bas dans la gamme audible sous la forme d'une pulvérisation incontrôlée de produits de distorsion d'intermodulation couvrant l'ensemble du spectre audible. La non-linéarité dans un amplificateur de puissance produira le même effet. L'effet est très faible, mais des tests d'écoute ont confirmé que les deux effets peuvent être audibles.

madamereve

Je t'emmerde!

J'aime ça!

Disons que je cherche à travailler sur le long terme sans être pris de furieuses crises de GAS permanentes ensuite (éviter les haricots blancs

Ma mackie onyx 1640I en firewire risque de rendre l'âme sans prévenir.

Mon projet est de trouver un bon endroit pour monter un studio associatif et de rentrer dans mes frais en enregistrant des "low budget bands" dans des bonnes conditions et d'offrir mes modestes compétences de producteur. Quand je serai en retraite, je continuerai mes activités dans ce sens pour rester actif et dans le flow.

Comme on peut chaîner 4 Quantum, ça fait 24 entrées + du adat à foison si l'on veut.

Disons aussi que se projeter fait du bien avec cet horizon sanitaire bouché.

Danbei

Je n'ai pas vu cela mentionné sur la fiche du produit de leur site et d’ailleurs il n'y a qu'un seul connecteur UBS-C sur la carte son

.

.Darkmoon

Citation de Harlequin :Ca ne baisse pas la latence justement de bosser à une fréquence plus élevée ?

Si mais ça demande plus de ressources processeur.

Oui, exactement!

Outre le passage sur le 192KHz que tu partages, le fait, par exemple, de bosser en 96KHz pour diviser par deux la latence est un piège dans lequel tous les newbs tombent un jour ou l’autre (avant de bien comprendre comment ça fonctionne).

Je recopie/colle une explication (avec ajouts) que j’avais déjà partagée ici :

Plus tu montes en fréquence, plus la latence diminue parce qu’il y a plus d’échantillons qui passent dans un même laps de temps. Mais, souvent, plusieurs ont tendance à effectuer le raisonnement contraire, ce qui est une erreur!

C’est physique et mathématique!

....Par exemple, si tu bosses en 44.1KHz/sec, il y a donc 44.1 échantillons/ms qui passent (suffit de diviser par 1000). Si tu bosses en 88.2kHz, il y a donc 88.2 échantillons/ms qui passent (suffit de diviser par 1000). Autrement dit, puisque l’horloge est plus rapide et fait passer plus d’échantillons pour le même laps de temps, la latence est donc moindre... ....puisque pour faire passer le même nombre d’échantillons à 88.2kHz qu’il en passe en 44.1KHz, ça prendra (en théorie), deux fois moins de temps!!

Si l’on suit bien le raisonnement, lorsque l’on bosse en 88.2KHz, il y aura 44.1 échantillons de traité dès 1/2 milliseconde alors que ça prend une milliseconde complète pour traiter 44.1 échantillons quand l’on bosse en 44.1KHz!

Conclusion : 44 échantillons sont traités plus rapidement (1/2ms) en 88.2KHz qu’en 44.1KHz (1ms). Ce qui veut dire que la latence est moindre puisque cette dernière n’a de sens que relativement au nombre d’échantillons traités dans un laps de temps donné!

Alors, pourquoi ne pas tout simplement toujours bosser en 96KHz ou même en 192KHz afin de bénéficier d’une latence plus basse?

Oui, nous y avons tous (enfin, plusieurs!) déjà pensé et déjà essayé!

...malheureusement parce que la charge processeur, elle, est nécessairement doublé (entre 44.1KHz et 88.2KHz, par exemple) parce qu’il y a 2 fois plus d’échantillons à traiter pour un même laps de temps donné!

Donc ce qu’on gagne en latence, on le perd en ressources processeur disponible pour exploiter des plugins. En pratique, nous allons donc finir (par avoir des glicths 2 fois plus rapidement en chargeant des plugins et donc) par remonter le buffer, ce qui doublera la latence et reviendra donc exactement au même.

Autrement dit, si tout baigne en 48KHz avec un buffer paramétré à 64smp, P. Ex., et que passer en 32smp provoque des glitchs, ben bosser avec un buffer paramétré à 64smp, mais en passant en 96KHz produit exactement le même résultat puisque le PC doit maintenant traiter autant de données~samples en 96KHz avec un buffer en 64smp qu’il en avait à traiter avec un buffer à 32smp en bossant en 48KHz.

Ou, encore, formulé différemment, en bossant en 96KHz en 64smp, le CPU à 2 fois plus de temps pour calculer (en rapport avec un buffer à 32smp), mais doit traiter 2 fois plus de données~samples alors qu’en bossant en 48KHz en 32smp, il a 2 fois moins de données à traiter (en rapport avec une freq de 96KHz), mais aussi 2 fois moins de temps, ce qui revient, pour formuler d’une 3e façon, que pour une même période de temps donnée, dans tous les cas, abaisser le buffer sans augmenter la fréquence ou augmenter la fréquence à laquelle l’on bosse sans modifier la valeur du buffer, reviens exactement au même en terme de données~samples que le CPU doit traiter — dans une même période de temps donné!

Bosser en 96Khz , outre le « supposé gain de qualité audio » (imperceptible àmha), n’est utile que dans certain cas très précis :

- utilisation massive de time stretching/pitchs shifting

- pour quelqu’un qui veut vraiment, mais vraiment la latence la plus basse possible et qui abaisse donc son buffer à 48, 32 ou 16smp (certaines interfaces permettent cette valeur parfois) en plus de bosser en 96Khz ou 192KHz et dont le PC est capable d’encaisser les quelques plugins qu’il utilisera pendant le cours de cette utilisation.

Sauf, qu’en pratique, dans la vie réelle, peu importe le PC et le CPU, bosser en 32smp ou moins simultanément qu'en 96KHz ou 192KHz, ça permet rarement (euphémisme) de pouvoir faire quoi que ce soit de très « conséquent » en terme de plugins utilisé. C’est rarement stable et sans aucun glitch à ses valeurs de buffer et fréquence.

C’est pourquoi d’ailleurs je cause souvent de buffer paramétré à 64smp (et prend cette dernière valeur comme référence lorsque j’observe divers tests et review sur la latence, ainsi que le 44.1KHz ou le 48KHz), car c’est à partir de cette valeur de buffer et ces fréquences qu’on peut réellement commencer à exploiter convenablement n’importe quel PC couplé avec une bonne interface audio sans devoir trop se limiter en terme d’instances de plugins.

En deçà, peu importe le CPU et l’interface audio, du moins en USB, c’est trop risqué. Et si l’on a bien pigé ce que j’explique plus haut, pour ceux qui bossent en 88,2KHz ou 96KHz, ben la valeur minimum du buffer habituellement exploitable, en USB, sera 128smp... ...et 256smp en 192KHz! ...car ça revient au même que de bosser avec un buffer à 64smp et en 44.1KHz ou 48KHz.

"Si t'enregistres à Poudlard, avec l'ingé son Dumbledore, les lois physiques tu peux t'en foutre. Mais dans l'monde réel, les lois physiques, les mesures, le dBFS, tout ça existe bel et bien." youtou

SpaceEko

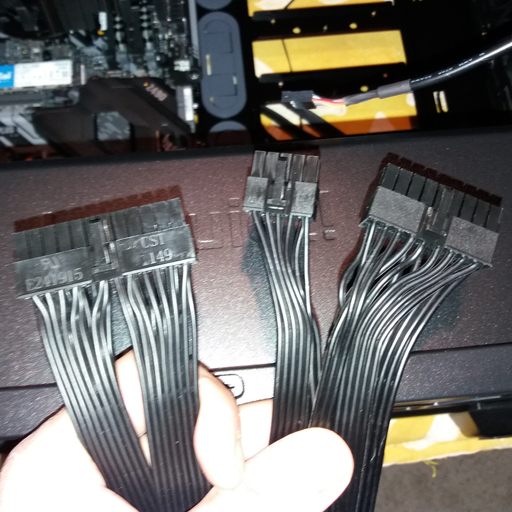

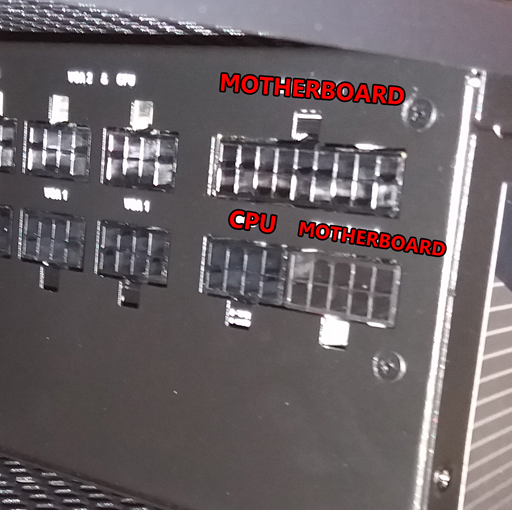

Le cable 24 pins qui alimente la carte mère est séparé en 2 à l'autre extrémité et le bloc alim a bien 2 branchements qui correspondent mais je préfère prévenir que tout flinguer :

(c'était flou donc j'ai retouché )

Est ce que vous pouvez me confirmer que je dois bien brancher les 2 broches sur le bloc alim ( 18pins + 10 pins = 28 pins ...

Merci d'avance , après ça , ça devrait aller...

Harlequin

Oui, exactement!

Mais ça veut aussi dire que sans utiliser de plugins ça a bien une certaine efficacité (je suppose que ça ne divise pas carrément par deux, mais sûrement un mieux non négligeable ?)

Par exemple si tu enregistres juste des groupes "à l'ancienne" avec du traitement hardware ou pas de traitement à la prise du tout, tu auras un gain de latence à 96Khz je suppose ?

Eric Music Strasbourg

Mais si on bosse sur de la musique de film et avec VEP de chez vienna ça a du sens. la charge processeur est répartie sur chaque ordinateur doté de vep...

Dans le reste des cas 44,1 ou 48 et c'est tout bon... Pour du 5.1 le 96 a du sens... Pour le reste non.. de toute façon il faut un ordi de fou pour gérer tout ça...

C'est dans ce type de souhait qu'un 5950x est le bienvenu.

Après si la prod fini en MP3 alors la question ne se pose pas...

Eric

madamereve

On peut chaîner les Quantum, mais est ce que tu es sur qu'on peut le faire avec les Quantum 2626 ?

Je n'ai pas vu cela mentionné sur la fiche du produit de leur site et d’ailleurs il n'y a qu'un seul connecteur UBS-C sur la carte son.

Sur PC, il faut des câbles NBC. Mais apparemment, le gars sur la deuxième vidéo n'arrive pas à sauvegarder sa config et doit la réarmer à chaque démarrage du PC.

madamereve

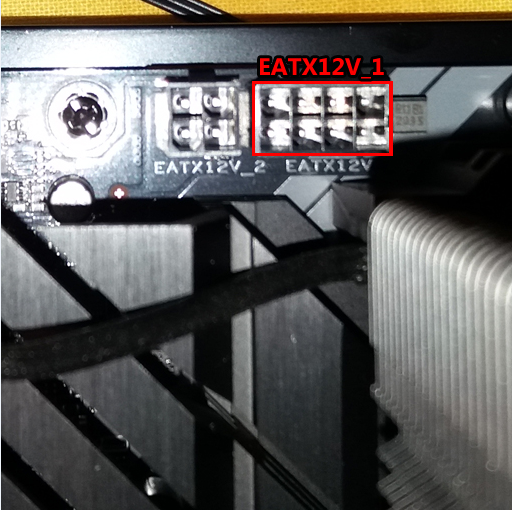

Est ce que vous pouvez me confirmer que je dois bien brancher les 2 broches sur le bloc alim ( 18pins + 10 pins = 28 pins ...) pour le relier au 24 pins de la carte mère svp ? Et ensuite relier le 8 pins CPU de l'alim sur le EATX12V_1 de la carte mère

Merci d'avance , après ça , ça devrait aller...

Il faut la référence de la carte mère pour le savoir.

madamereve

Après si la prod fini en MP3 alors la question ne se pose pas...

Exactement! C'est dans ce contexte de musique populaire qu'il faut raisonner si c'est notre domaine. A quoi bon mixer en 96 khz si ça finit sur des plateformes de streaming.

Pour la musique de films ou du classique, je n'y connais rien.

Ceci dit, les algos de certains sont meilleurs que d'autres. Youtube est le pire, privilégiant évidemment la vidéo. Et sur certains tutos quand des gars manipulent des eq's ou des comps faut de bons moniteurs ou des oreilles de chauve-souris pour percevoir la diff.

En revanche sur spotify et d'autres plateformes, si le mastering est bon et qu'il respecte bien les niveaux imposés, faire la diff avec le wav d'origine n'est pas un mince affaire pour les novices que sont la plupart des utilisateurs. En tout cas, c'est comme ça que les gens consomment de la musique aujourd'hui et avec un bon casque ou des enceintes de qualité honorable, sans mettre des millions, ça passe très bien. Les algos ont évolué. Le 128 kb des débuts avec des bitrates ignobles était atroce, le principe du mp3 étant de réduire de l'information en arrière plan pour réduire le poids du fichier.

Le principe du mp3 date des années 80 et a donc évolué et maintenant, il est dans le domaine public. Donc, chacun peut en faire ce qu'il souhaite pour l’améliorer.

Dans ma cuisine, j'ai les petites ikmultimédia Iloud bluetooth et j'écoute de la musique et vérifie mes mixs avec. Elles sont étonnantes et les gens sont impressionnés par ces petits bidules.

Pensons à la pauvre qualité de retransmissions de l'audio il y a des décennies sur des radios mono et des platines pourries...

SpaceEko

Il faut la référence de la carte mère pour le savoir.

Ah effectivement j'aurais du préciser mais de toute façon c'est bon je m'en suis sorti , merci.

madamereve

Ah effectivement j'aurais du préciser mais de toute façon c'est bon je m'en suis sorti , merci.

Cool, alors!

Eric Music Strasbourg

Peut être un peu moins puissant que le 5950 mais faut voir le prix et la disponibilité.... ( Pour ceux qui ont besoin d'une fusée). En tous cas sur le papier il arrive à bien concurrencer le 5900...

Mais bon c'est toujours pareil, sans test comparatif... Les derniers datent un peu me semble t'il 2019? Où y a t'il eu du neuf?

https://www.tomshardware.fr/intel-detaille-sa-gamme-rocket-lake-s-le-core-i9-11900k-annonce-superieur-au-ryzen-9-5900x-dans-les-jeux/

Eric

Eric Music Strasbourg

du coup je voulais revendre mon ryzen 9 3900x... 300 euros c'est bien ou pas..?

Eric

Eric Music Strasbourg

Citation de Darkmoon :Oui, exactement!

Mais ça veut aussi dire que sans utiliser de plugins ça a bien une certaine efficacité (je suppose que ça ne divise pas carrément par deux, mais sûrement un mieux non négligeable ?)

Par exemple si tu enregistres juste des groupes "à l'ancienne" avec du traitement hardware ou pas de traitement à la prise du tout, tu auras un gain de latence à 96Khz je suppose ?

non tu n'auras pas de gain à traiter par du hardware... la latence reste la latence... par contre le nombre de pistes sera plus important puisque le cpu n'aura que ça à traiter dans le même temps imparti c'est à dire la latence...

la seule chose que tu puisses gagner c'est la coloration de ton son. avoir une identité personnelle par rapport à d'autres studios utilisant les mêmes plugins (mais les réglages jouent aussi)... mais bon ça n'est pas rien...

Eric

Pat.Rick

Bref, étant un fana de la plus basse latence possible (et des optimisations PC), j'ai souvent songé et été tenté de prendre une Zoom UAC, mais, question qualité/stabilité, j'ai toujours été un peu moins « emballé ». Voilà pourquoi j'ai préféré une autre marque au final.

Super, merci pour les infos, qui me rassure.

Je te (vous) dirai, ce que l'UAC donne quand je vais la recevoir ... quand je vais la commander lol.

Si non, j'ai une autre question concernant les cartes son, mais de nature plus logiciel.

J'ai posé la question le topique qui concerne la Berhinger XR18, mais je suis ressorti bredouille. Pour expliquer, j'ai :

- 1 studio Mobile avec : Ma table de Mixage XR18 qui me sert de carte son.

- 2 Home studio avec : Ediroll SD90 (ma vielle casserole), et ZOOM UAC8 (dans un futur proche).

L'idée pour moi est de pouvoir utiliser les Entré 16 entrées de l'XR18 occasionnellement, en parallèle des entrés de l'UAC8. dans cubase.

Le problème viens de L'XR18 qui fait parti du rare matériel non-reconnu par "ASIO4ALL". Je suis tombé sur des trucs du style : "ASIO2WASAPI" et "FlexASIO", mais sans succès. (c'est peut etre moi qui ai pas su pas faire

, mais ça marche pô)

, mais ça marche pô)ps: j'ai été agréablement surpris par la qualité de l'XR18 en guise de carte son, puisque sans être le top elle est bien si ont pousse pas trop niveau du gain.

Tout cela pour demander si il y a un moyen d'utiliser l'XR18 et d'autres carte son, en même temps. Pour faire simple, j'aimerai savoir si il existe une alternative viable a "ASIO4ALL" ?

FPat.Rick Un Hero se cache en chacun de nous : Jesus. Do it your self now.

Darkmoon

Citation de Darkmoon :Oui, exactement!

Mais ça veut aussi dire que sans utiliser de plugins ça a bien une certaine efficacité (je suppose que ça ne divise pas carrément par deux, mais sûrement un mieux non négligeable ?)

Par exemple si tu enregistres juste des groupes "à l'ancienne" avec du traitement hardware ou pas de traitement à la prise du tout, tu auras un gain de latence à 96Khz je suppose ?

De toute façon, si l'on utilise aucun traitement à la prise, aussi bien activer le « direct monitoring » (toute les cartes son possèdent cette fonction) et, du coup, il n'y a plus aucune latence, zéro, nichts, rien!

Pour ceux qui ignorerait ce qu'est le « direct monitoring », c'est que la carte son bypass alors — pour l'écoute seulement — (le son est quand même envoyé vers le DAW afin d'être enregistré) le trajet de ses entrées vers le DAW, et ressort directement le signal vers sa sortie audio (casque et/ou moniteurs). Du coup, l'utilisateur entend directement, sans aucune latence (vraiment aucune!), ce qu'il fait avec ce qui est branché (micro, guitare, etc.) dans l'entrée de sa carte son.

"Si t'enregistres à Poudlard, avec l'ingé son Dumbledore, les lois physiques tu peux t'en foutre. Mais dans l'monde réel, les lois physiques, les mesures, le dBFS, tout ça existe bel et bien." youtou

Danbei

48KHz, 64 samples => latence 8.10ms

96KHz, 128 samples => latence 7.40ms

Donc il y a peut être un avantage au niveau de la latence en augmentant la fréquence d’échantillonnage. Cela dit c'est pas énorme non plus.

Danbei

Ceci dit, les algos de certains sont meilleurs que d'autres. Youtube est le pire, privilégiant évidemment la vidéo.

J'aurai plutôt dis que YouTube est parmi les meilleurs

Le gros problème de YouTube ce n'est pas leur algo, mais c'est que les gens qui upload ne maîtrisent pas toujours ce qu'ils font. Ce qui est malheureusement souvent fait :

1) Import de l'audio (non compressé) dans un logiciel de montage

2) Montage

3) Export de la vidéo (avec son et image) avec compression de l'audio

4) Upload sur YouTube

5) Compression par Youtube de l'audio (et de la vidéo, mais ici on s'en fiche)

C'est à l'étape 3 que le son est parfois abîmé. Non seulement il y a deux étapes de compression (ce qui est inutile et source de problèmes), mais en plus les paramètres de compressions audio de l'étape 3 sont souvent mal choisi (souvent les paramètres par défauts du logiciel).

L'algorithme de compression audio utilisé par YouTube (opus) est objectivement parmi les meilleurs.

Pour les vidéos musicales YouTube recommande de ne pas compresser l'audio dans le fichier vidéo uploadé.

Donc je mettrais plutôt la faute sur les utilisateurs que sur YouTube

.

.Cela dit, j'ai personnellement rarement à me plaindre de la qualité audio sur YouTube.

Le principe du mp3 date des années 80 et a donc évolué et maintenant, il est dans le domaine public. Donc, chacun peut en faire ce qu'il souhaite pour l’améliorer.

Deltank

Il s'agit d'un algorithme d'ajustement du niveau moyen (loudness normalisation), qui sert à limiter les écarts de niveaux perçus quand l'utilisateur passe d'une vidéo à l'autre.

En gros il s'agit d'un nivellement par le bas, qui ramène à un niveau de référence le son des vidéos ayant un niveau moyen au dessus de ce seuil de référence (-14 LUFS).

Pour le vérifier, faire un clic droit sur la vidéo YouTube, et aller dans Stats.

Apparaitra parmi les paramètres de la vidéo les valeurs Volume/Normalized, qui indiquent comment le niveau audio est traité ou non par YouTube.

Pour ceux qui veulent en savoir plus : YouTube just put the final nail in the Loudness War’s coffin

"Le monde se divise en deux catégories : ceux qui passent par la porte, et ceux qui passent par la fenêtre." (Tuco)

Eric Music Strasbourg

En plus de la compression de donnée liée à l'optimisation du stockage, YouTube applique un traitement audio temps réel sur toutes les vidéos diffusées, non destructif pour les données, mais potentiellement destructif sur le niveau moyen de la bande son.

Il s'agit d'un algorithme d'ajustement du niveau moyen (loudness normalisation), qui sert à limiter les écarts de niveaux perçus quand l'utilisateur passe d'une vidéo à l'autre.

En gros il s'agit d'un nivellement par le bas, qui ramène à un niveau de référence le son des vidéos ayant un niveau moyen au dessus de ce seuil de référence (-14 LUFS).

Pour le vérifier, faire un clic droit sur la vidéo YouTube, et aller dans Stats.

Apparaitra parmi les paramètres de la vidéo les valeurs Volume/Normalized, qui indiquent comment le niveau audio est traité ou non par YouTube.

Pour ceux qui veulent en savoir plus : YouTube just put the final nail in the Loudness War’s coffin

Fort intéressant d'aller vers du mieux et plus vivant... La dynamique accroît l'émotion en laissant la musique respirer, vivre!!!

Eric

madamereve

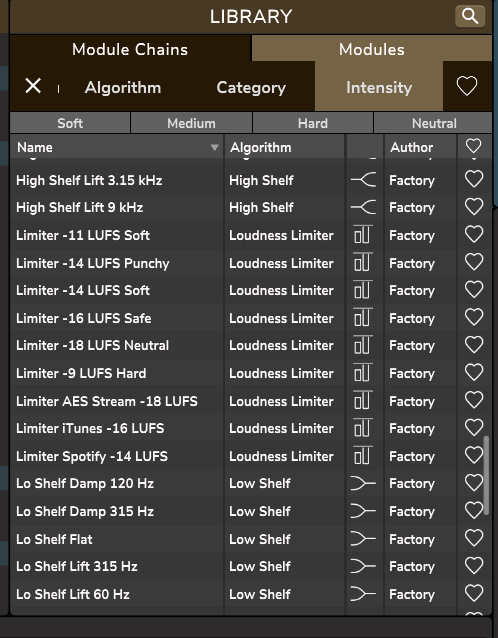

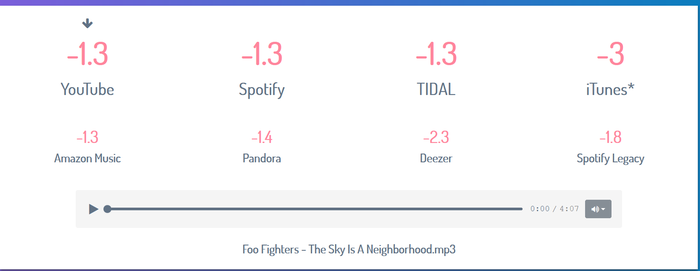

testez vos fichiers masterisés pour le streaming avec ceci (il existe également un plugin de la marque) :

https://www.loudnesspenalty.com/#

Avec cet analyseur, on voit clairement que chaque plateforme a des exigences de loudness qui varient.

J'ai vraiment étudié le truc depuis que je fais plus de vidéos. J'utilise TC finaliser de TC electronics pour une approche vraiment dynamique. Mais même dans ce cas, on peut choisir un algo soft, médium, hard au niveau de la perception sonore.

Logiciel TC electronics finaliser:

Téléchargez un tire de Foofighter "The Sky Is A Neighborhood", par exemple, et analysez-le avec loudness penalty... Je l'ai fait et on arrive sur du -12 voire -11 lufs. Car ici, c'est une moyenne qui est calculée.

Harlequin

Eric Music Strasbourg

Tiens j'ai une question un peu spécifique, quand on utilise des machines esclaves pour VEP, l'ethernet représente t'il un goulot d'étranglement ? (par rapport à des ssd internes)

oui et la catégorie de câble est importante... par contre je ne pourrais donner aucun conseil sur les paramétrage réseau je n'ai fait que des conneries et je n'ai plus aucune sécurité sur mes ordi... mais bon ca marche sauf le partage des fichiers...

le changement de cable m' éliminé les glitsch que j'avais très rapidement et sans utilisation à outrance... j'ai cherché un moment...

Eric

madamereve

Tiens j'ai une question un peu spécifique, quand on utilise des machines esclaves pour VEP, l'ethernet représente t'il un goulot d'étranglement ? (par rapport à des ssd internes)

Tout dépend de ton matériel :

Connexion classique de PC à PC 1 gbits.

Ensuite, il y a des cartes spécifiques pour le 5 gbits et le 10 gbits. Il faut investir dans des cartes réseaux PCIE avec des switchs et des câbles cat 6 ou 7 de bonne qualité. ça dépend aussi de la puissance des machines, de la ram installée sur le serveur et dans ton PC... Un réseau n'est pas si compliqué à configurer (deux adresses Ip qui doivent se voir), il y a des tutos bien faits pour cela. j'ai renommé mes ordis. PC1 et PC2 avec audiogridder et même pas besoin d'avoir les mêmes plugins sur la machine esclave. Tu peux juste installer tous tes vsti et plugins sur le serveur, audiogridder va les scanner et te les monter avec l'interface sur ton PC de production. C'est toute la diff avec VEP.

L'intérêt d'un serveur dédié, c'est que tu peux y mettre de la ram EEC jusqu'a 256 gigas et plus et configurer tout tes disques en raid avec du cache qui accélère le chargement des banques. Pour l'instant, j'ai deux ports en 1 gigabit sur mon pc maître, je peux donc utiliser internet et un réseau privé (très important) pour audiogridder.

Bref, je verrais ça après l'achat de mes cartes son presonus.

On nous promet du 40 gigabits pour bientôt...

- < Liste des sujets

- Charte